(SeaPRwire) – Noong 1960, si Herbert Simon, na naging nagwagi ng parehong Nobel Prize para sa ekonomiks at Turing Award para sa agham pangkompyuter, sa kanyang aklat na The New Science of Management Decision na “ang mga makina ay magiging kaya sa loob ng 20 taon, na gawin ang anumang gawain na magagawa ng tao.”

Puno ng mga masiglang paghula sa teknolohiya na hindi nagkatotoo. Sa larangan ng artificial intelligence, ang pinakamalakas na paghula ay tungkol sa pagdating ng mga sistema na magagawa ang anumang gawain ng tao, madalas tinutukoy bilang artificial general intelligence, o AGI.

Kaya nang sabihin ni Shane Legg, co-founder at chief AGI scientist ng Google DeepMind, na may 50% na tsansa na ang AGI ay mauunlad sa 2028, maaaring mapagkamalang isa siya sa iba pang pioneer ng AI na hindi natuto sa mga aral ng kasaysayan.

Ngunit lubhang umaasenso nga ang AI. Ang GPT-3.5, ang language model na nagpapatakbo sa ChatGPT ng OpenAI ay inimbento noong 2022, at nakakuha ng 213 sa 400 sa Uniform Bar Exam, ang standard na pagsusulit na dapat pasado ng mga nag-aaral ng abogasya, na naglilok sa 10% sa ilalim ng mga taga-tao. Ang GPT-4, na inimbento lamang ilang buwan pagkatapos, ay nakakuha ng 298, na naglilok sa 10% sa itaas. Marami ang nag-aasam na magpapatuloy ang progreso na ito.

Karaniwan ang pananaw ni Legg sa mga lider ng mga kompanya na nagtatayo ng pinakamakapangyarihang sistema ng AI. Noong Agosto, , co-founder at CEO ng Anthropic, na inaasahan niyang ang isang “antas-tao” na AI ay maaaring maimbento sa loob ng dalawa hanggang tatlong taon. Si Sam Altman, CEO ng OpenAI, na maaaring abutin ang AGI sa loob ng apat o limang taon pa.

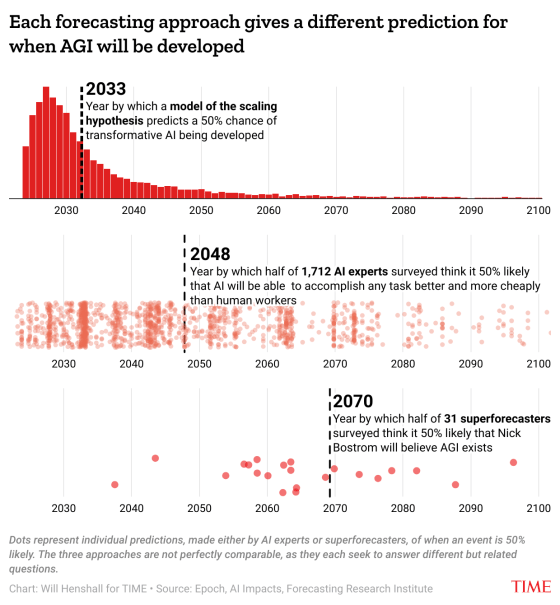

Ngunit sa isang kamakailang survey, ang karamihan sa 1,712 na eksperto sa AI na sumagot sa tanong kung kailan nila inaasahan na ang AI ay magagawa ang bawat gawain nang mas mabuti at mas mura kaysa sa mga manggagawa ay mas konserbatibo. Isang hiwalay na survey ng mga elite na tagapag-ulat na may pagkakataong napatunayan ay mas konserbatibo pa.

Mataas ang kahihinatnan para malaman kung sino ang tama. Si Legg, tulad ng maraming iba pang pioneer ng AI, ay nagsabi na ang makapangyarihang sistema ng AI sa hinaharap ay maaaring magdulot ng pagkawasak ng tao. At kahit para sa mga hindi gaanong nag-aalala sa mga “doomsday” na senaryo, ilan ay nagbabala na ang isang sistema ng AI na maaaring palitan ang tao sa anumang gawain ay maaaring magdulot ng pagkawala ng trabaho.

Ang hypothesis ng pag-iikot

Marami sa mga nagtatrabaho sa mga kompanya na nagtatayo ng pinakamalaking at pinakamakapangyarihang modelo ng AI ay naniniwala na malapit na ang pagdating ng AGI. Sila ay sumasang-ayon sa isang teoriyang kilala bilang hypothesis ng pag-iikot: ang ideya na kahit kailangan pa ng ilang pag-unlad sa teknikal sa landas, ang patuloy na pagsasanay ng mga modelo ng AI gamit ang patuloy na lumalaking halaga ng kapangyarihan ng pagkukwenta at datos ay hindi maiwasang magdadala sa AGI.

May ilang ebidensya upang suportahan ang teoriyang ito. Nakakita ang mga mananaliksik ng napakalinaw at maaasahang ugnayan sa pagitan ng halaga ng kapangyarihan ng pagkukwenta, na kilala rin bilang “compute,” na ginamit upang pagsanayin ang isang modelo ng AI at kung paano ito kumilos sa isang ibinigay na gawain. Sa kaso ng malalaking modelo ng wika (LLM)—ang mga sistema ng AI na nagpapatakbo sa mga chatbot tulad ng ChatGPT—ang mga batas ng pag-iikot ay naghula kung paano ito makapagpapaliwanag ng isang nawawalang salita sa isang pangungusap.

Bago pa man maobserbahan ang mga batas ng pag-iikot, matagal nang nauunawaan ng mga mananaliksik na ang pagsasanay ng isang sistema ng AI gamit ang mas maraming kapangyarihan ng pagkukwenta ay nagpapahusay nito. Ang halaga ng kapangyarihan ng pagkukwenta na ginagamit upang pagsanayin ang mga modelo ng AI ay nang naaayon sa nakalipas na 70 taon habang bumababa ang gastos.

Ginamit ang maagang mga paghula batay sa inaasahang paglago ng kapangyarihan ng pagkukwenta ng mga eksperto upang hulaan kung kailan maaaring magkatulad (at pagkatapos ay maaaring lumagpas) ang AI sa tao. Noong 1997, siyentipikong computer na si Hans Moravec ang nagsabi na ang murang available na hardware ay magkakatulad sa kapangyarihan ng pagkukwenta ng utak ng tao sa 2020s. Ang isang chip na semiconductor na Nvidia A100, malawak na ginagamit para sa pagsasanay ng AI, ay nagkakahalaga ng humigit-kumulang $10,000 at maaaring magaganap ng halos 20 trillion FLOPS, at ang mga chip na inimbento sa huling bahagi ng dekada ay magkakaroon ng mas mataas na kahusayan pa rin. Ngunit ang mga estimasyon para sa halaga ng kapangyarihan ng pagkukwenta na ginagamit ng utak ng tao ay labis na iba-iba mula sa humigit-kumulang 37 petaFLOPS hanggang higit sa 300 petaFLOPS, na nagiging mahirap suriin ang paghula ni Moravec. Bukod pa rito, kinakailangan ng malaking halaga ng kapangyarihan ng pagkukwenta upang pagsanayin ang mga modernong sistema ng AI kaysa sa pagpapatakbo lamang nito, isang katotohanan na hindi inakala ng paghula ni Moravec.

Mas kamakailan, gumawa ng isang mas sopistikadong pagtataya ang nonprofit na Epoch. Sa halip na hulain kung kailan pagsasanayin ng AI ang mga modelo gamit ang halaga ng kapangyarihan ng pagkukwenta na katulad ng utak ng tao, ang paghula ng Epoch ay gumagamit nang tuwiran ng mga batas ng pag-iikot at gumagawa ng simpleng pag-aangkin: Kung ang isang modelo ng AI na pagsasanayin gamit isang ibinigay na halaga ng kapangyarihan ng pagkukwenta ay makapagpatotoo nang mahusay ng isang bahagi ng teksto—batay kung ang mga batas ng pag-iikot ay nanghula na ang gayong modelo ay maaaring patuloy na hulaan ang susunod na salita nang lubos—pagkatapos ay maaaring gawin nito ang gawain ng paglikha ng tekstong iyon. Halimbawa, isang sistema ng AI na maaaring perpektong muling lumikha ng isang aklat ay maaaring palitan ang mga may-akda, at isang sistema ng AI na maaaring muling lumikha ng mga papel pang-agham nang walang kamalian ay maaaring palitan ang mga siyentipiko.

Ang ilan ay maaaring sabihin na kahit ang mga sistema ng AI ay makagagawa ng mga output na katulad ng tao, hindi nangangahulugan na mag-iisip ito tulad ng tao. Sa katunayan, si Russell Crowe ay naglaro bilang matematikong si John Nash sa pelikulang 2001 na A Beautiful Mind, ngunit walang sasabihin na mas magaling ang kanyang pagganap, mas impresibo ang kanyang kakayahan sa matematika. Sinabi ng mga mananaliksik sa Epoch na mali ang pagkakaintindi sa ganitong halimbawa dahil nakabatay ito sa maliwanag na pag-unawa kung paano gumagana ang mga modelo ng wika. Habang lumalaki, ang mga LLM ay nakakakuha ng kakayahan upang mag-isip tulad ng tao, sa halip na simpleng nag-iimite ng pag-uugali ng tao. Ngunit ayon sa ilan, hindi malinaw kung ang mga modelo ng AI ngayon ay tunay na nag-iisip.

Ang paghula ng Epoch ay isang paraan upang sukatin ang hypothesis ng pag-iikot nang quantitatively, ayon kay Tamay Besiroglu, associate director ng Epoch, na sinasabi na ang mga mananaliksik sa Epoch ay mas madalas na naniniwala na mas mabagal ang pag-unlad ng AI kaysa sa ipinapakita ng modelo. Inaasahan ng modelo ang 10% na tsansa ng transformative na AI—na inilalarawan bilang “AI na kung ipapatupad nang malawak, ay magdudulot ng pagbabago na katulad ng rebolusyong industriyal”—na mauunlad sa 2025, at 50% na tsansa na mauunlad ito sa 2033. Ang pagkakaiba sa paghula ng modelo at ng mga tulad ni Legg ay malamang dahil mas mahirap na abutin ang transformative na AI kaysa sa AGI, ayon kay Besiroglu.

Tinatanong ang mga eksperto

Bagaman marami sa mga lider ng posisyon sa pinakamakilalang kompanya ng AI ay naniniwala na ang kasalukuyang landas ng progreso ng AI ay maaaring madaling lumikha ng AGI, sila ay mga outlier. Upang mas sistematikong suriin ang paniniwala ng mga eksperto tungkol sa hinaharap ng artificial intelligence, ang AI Impacts, isang proyekto sa seguridad ng AI sa nonprofit na Machine Intelligence Research Institute, ay nagsagawa ng survey sa 2,778 eksperto noong taglagas ng 2023, lahat ng kanilang nakapagpublika ng peer-reviewed na pananaliksik sa pinakamahuhusay na journnal at conference ng AI sa nakalipas na taon.

Sa iba’t ibang bagay, tinanong ang mga eksperto kung kailan sila naniniwala na “makataas na intelihensiya ng makina,” na inilalarawan bilang mga makina na “maaaring gampanan ang bawat gawain nang mas mabuti at mas mura kaysa sa mga manggagawa ng tao” nang walang tulong, ay magiging posible. Bagaman iba-iba ang mga indibiduwal na paghula, ang katamtaman ng mga paghula ay nagmumungkahi ng 50% na tsansa na mangyayari ito sa 2047, at 10% na tsansa sa 2027.

Tulad ng maraming tao, mukhang nagulat ang mga eksperto sa mabilis na progreso ng AI sa nakaraang taon at nag-update ng kanilang mga paghula ayon dito—nang tumakbo ang parehong survey ng AI Impacts noong 2022, inaasahan ng mga mananaliksik ang 50% na tsansa ng makataas na intelihensiya ng makina sa 2060, at 10% na tsansa sa 2029.

Tinanong din ang mga mananaliksik kung kailan nila inaasahan na ang iba’t ibang indibiduwal na gawain ay maaaring gampanan ng mga makina. Inaasahan nila ang 50% na tsansa na ang AI ay makagawa ng Top 40 hit sa 2028 at magsulat ng aklat na magiging bestseller sa New York Times sa 2029.

Ang artikulo ay ibinigay ng third-party content provider. Walang garantiya o representasyon na ibinigay ng SeaPRwire (https://www.seaprwire.com/) kaugnay nito.

Mga Sektor: Pangunahing Isturya, Balita Araw-araw

Nagde-deliver ang SeaPRwire ng sirkulasyon ng pahayag sa presyo sa real-time para sa mga korporasyon at institusyon, na umabot sa higit sa 6,500 media stores, 86,000 editors at mamamahayag, at 3.5 milyong propesyunal na desktop sa 90 bansa. Sinusuportahan ng SeaPRwire ang pagpapamahagi ng pahayag sa presyo sa Ingles, Korean, Hapon, Arabic, Pinasimpleng Intsik, Tradisyunal na Intsik, Vietnamese, Thai, Indones, Malay, Aleman, Ruso, Pranses, Kastila, Portuges at iba pang mga wika.

Mas mapag-ingat ang mga superforecaster

Ngunit marami pa ring ebidensya upang ipahiwatig na ang mga eksperto ay hindi magaling na